Facebook的清道夫,互聯網的陰暗之地

——吳曉波

幾年前,扎克伯格在生日演講中講到,Facebook的理想是讓這個世界變成一個統一的社區,他將會繼續“打造全球性社區,加深人與人之間的聯系,讓任何人都可以分享任何東西”作為 Facebook的創建初心。

多年來,扎克伯克堅持認為,Facebook既然只是個連接世界的平臺,就不用對在這個平臺上發布的內容負責。結果就是,這樣的認知給Facebook帶來了巨大的麻煩,使Facebook過去兩年間在內容監管方面飽受批評。

的確,早期的網絡治理曾經主張網絡中立,崇尚網絡自由主義,強調道德自律,也因此形成了互聯網原教旨主義:讓這個世界沒有信息的不平等,任何一個信息可以無障礙、免費化的方式到達全世界的任何地方。我們每一個人將變成世界大同中的一部分。

然而隨著非法、有害信息不斷傳播,網絡犯罪和盜版日益猖獗,全面加強網絡監管的呼聲日益成為主流。

早在2007年,Facebook因為年輕用戶看到了性侵和其他不恰當的內容受到了49位州司法部長的激烈批評,特別是在發生了數據門(操縱大選)之后,公眾和輿論促使Facebook將自己的審查制度一再升級,不斷調整自由表達和極端言論之間的平衡點。

為此,扎克伯克最近兩年來對外宣稱,Facebook已經引入事實核查,聘請更多的專業人士加入,同時加大力度研發算法。

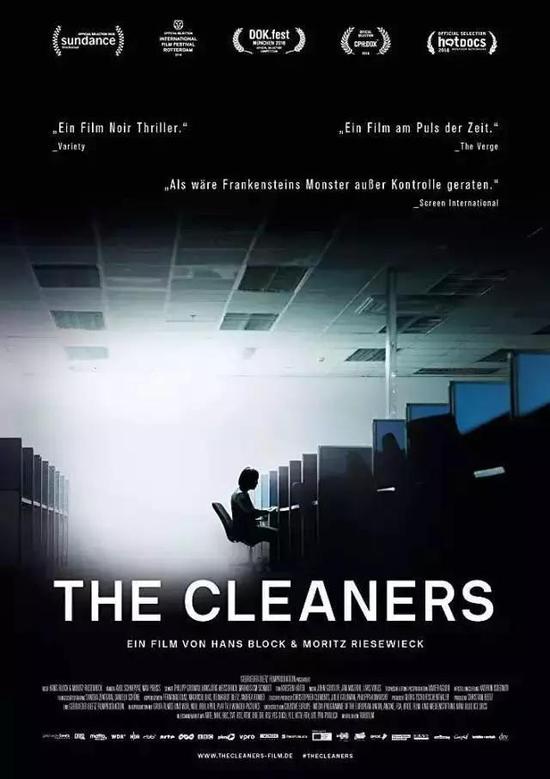

但實際上,在2018年上映的一部紀錄片中,揭露了算法和專家背后,真正對抗著世界的暗面的那些人。

1

上帝、天使、清道夫

在Facebook之前,很多企業就已經注意到了內容審核的重要性。一直試圖將兒童色情、極端信息、虛假內容、惡作劇和各種令人討厭的帖子關閉掉,同時留下其它類型的信息繼續保持流通。

但是負責內容篩選或甄別的并不是企業宣稱的專家和AI算法,而是一個個真人組成的審查員團隊。

這部去年上映的紀錄片,描述的對象便是所謂的網絡清道夫。他們供職于世界上最大的社交網站Facebook,或世界上最大的搜索網站Google。他們并不是這些企業的員工,而是屬于外包人員,任職于菲律賓的一家審核公司。

審查員們的工作就是扮演著互聯網上帝的角色,審核每一張上傳的圖片和每一條視頻,他們對這些圖片和視頻,掌握著生殺大權,決定著對這些內容能夠保留還是刪除。

在紀錄片中,沒有經過內容審核機制的互聯網,充滿了這個世界的沖突。

種族的,還是意識形態上的,好像所有人都在網上宣泄觀點和情緒。一些恐怖主義見縫插針如病毒蔓延。在海洋般的信息流中,虐殺、自殘、色情、極端組織言論、政治宣傳夾雜在各式貓咪、美食和旅行的照片里面,大量的垃圾信息需要有人來負責清理。

成為審查員之前,這些人需要經過三到五天的上崗培訓,培訓的內容,例如必須在三到五天內記住37個恐怖組織——他們的旗幟、制服、諺語。

通過類似這樣的培訓,審查員上崗并化身成為道德天使,通過機械又辛勞的工作,使人們相信對社會的美好想象。

但這些人并非受過良好的教育,他們大多沒有良好的文化教育背景,有的甚至剛剛學會用電腦。每天所要面對的,是恐怖主義,兒童色情,自殘虐殺等等你不愿觸碰的灰色地帶,“習慣每天看著上百人死去”。因此他們被稱為互聯網中最“臟”的職業。

很多人將這份工作視為“福利”,因為審查員們的工作就是強制涉獵大量黃色圖片、文字、視頻等,但實際上,這些人每天要審核25000條內容,每一張圖片的判斷時間只有短短的八秒。

有些負責暴力視頻的審查員,每天要看大量血肉橫飛,殘肢斷臂的畫面,還有更多聳人聽聞的視頻,包括虐待婦女、兒童和動物。有人表示他們每看幾個視頻就得休息一下才能緩過勁兒來。在日積月累的病態工作下,審查員們漸漸麻木,喪失了對人類的信心。

“當我離開公司時,我已經三年沒有握手了,因為我發現人們很惡心。我只是無法觸及人,”

高額的工資?不存在的。幾年前,國內某家互聯網公司以20萬高薪招聘“首席淫穢色情鑒定官”,但實際上,在招聘網站中網絡信息審核員這一職位的平均工資只有5-7千元左右。相比我國,紀錄片中出現的審查員時薪僅有1美金。

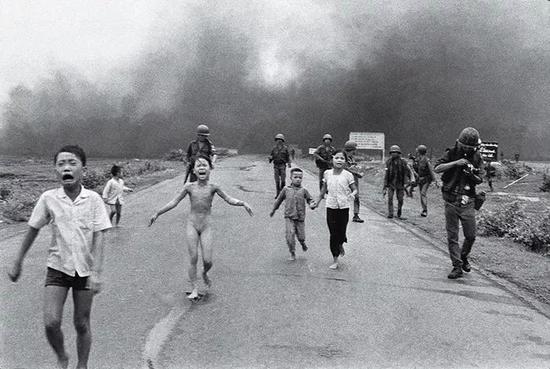

還有人會痛恨這些網絡審查。認為審核破壞了自由。比如一位藝術家創作的川普油畫,因為畫中人是裸體,所以被清道夫刪除。藝術品和成人照片的界限,往往在這時變得模糊不清。

另一位攝影家,通過拍攝了戰爭中死去的少年,希望引起人們對戰爭的反思。但清道夫們覺得它會宣揚暴力,因此刪除了照片。

幾乎每個審查員都或多或少因為這份工作產生了心理陰影,那為什么不選擇辭職另謀出路?

除了養家糊口的經濟壓力外,相當一部分審查員也因為這份工作產生的自豪感而選擇繼續留下。

“如果我們沒有工作一小時,那互聯網就會一團糟。” 片中一位審查員說到。

Facebook在2017年的遭遇印證了這句話:一名泰國男子在播放了殺害11個月大的女兒后自殺的視頻。這段視頻引起了全世界的一片嘩然,并在社交網絡上保留了近24個小時,這讓Facebook成為眾矢之的。

因此,Facebook的內容管理員從2017年的1萬人,增加到2019年的3萬人。

如此龐大數量的審查員卻被要求,絕對不會透露他們為誰而工作,如果違反了保密協議,他們就會失去工作并面臨10000美元罰款,甚至牢獄之災。

為什么不能說?因為一旦泄露了這些秘密,會對互聯網巨頭們的廣告收入造成嚴重影響。要知道,Facebook和Google一起占據了全球80%的數字廣告收入。

為此,Facebook將這項工作包裝成一個叫做honeybadger(蜜獾)的項目,審核員們只能說自己正在做一個關于honeybadger項目或者自稱是社區運營的數據分析師。

Facebook當然也考慮過試圖采用AI來審核網站內容,但目前來看還有一段距離。

Facebook曾在今年3月份宣布,將推出一套能夠識別出試圖自殺或自殘的用戶的AI系統。這套系統通過比對用戶的帖子和評論與其先前帖子的相似性來判斷其自殺的風險。

如果系統判斷某條帖子具有自殺傾向,就會在其他用戶瀏覽這條帖子時,突出顯示“上報自殘”的選項。

值得注意的是,是否上報最終還是由人來決定的。AI無法判斷,它只能提供幫助。

2

網絡監管走向何方

Facebook之所以此前極力推崇互聯網原教旨主義,與其商業模式有著直接的聯系——通過獲取和追蹤海量免費內容以及用戶數據,推送更精準的廣告。

因此互聯網巨頭需要通過推薦算法攫取更多的注意力。在華爾街日報的一項調查中發現,YouTube的算法推薦,就會把用戶一步步導向越來越極端的觀點和內容,這是抓住用戶注意力的最好辦法。

如果你經常關注新聞的話,格力、格蘭仕、伊利、小米等廠商在近一個月頻頻開撕,做法似乎已經變得有些無所不用其極,但也同時吸引了大量用戶的注意力。

眼球經濟和推薦算法,正在將互聯網引入極端,如果沒有恰當的內容審核,往下滑一步也許就意味著深淵。

就像連線雜志評論的那樣,Facebook帶來的是更分裂而不是更加開放和緊密連接。(You can’t make the world more open and connected if you’re breaking it apart.)

包括美國本土和歐盟在內,Facebook面臨著越來越強的監管壓力,監管之路卻充滿了各方博弈。

在意識到網絡監管的必要性之后,扎克伯格3月在華盛頓郵報上發表了一篇文章,不僅主動提出監管機構應該更加活躍,并且應該在一些區域中更加深度介入。

例如,扎克伯格在提一條建議中就呼吁組建一個第三方獨立機構,制定審核內容的統一標準,規定好內容的邊界,把控諸如校園霸凌、自殺、恐怖暴力等不得體的內容。

如果你關注了過去一年Facebook與監管機構之間的爭斗會發現,小扎在文章中的所有建議似乎都是在“自縛手腳”,處處針對發生在自己身上的經歷和丑聞下狠手。

但美國一家智庫分析,這Facebook提出這建議,不僅撇清了與監管之間的關系,還能夠進一步鞏固公司的市場地位。

作為內容提供的主體,互聯網企業需要通過技術手段主動照顧好包括未成年人在內的平臺上的一切活動,有了獨立機構對于內容的統一管理,Facebook就完全有理由在出事后把皮球踢給標準和監管機構,一切都按照監管的要求辦事,從此降低被起訴的風險。

同時,當企業做到規模足夠大之后,對于監管機構會出現反制力,從而左右監管機構的決策。美國智庫機構預測,Facebook會通過游說來確保新規則有利于自己而不是競爭對手。

無論如何,Facebook在短期內依舊會“我行我素”,一方面繼續通過人工+AI的方式審核越來越多的內容,另一方面與監管機構陷入不休的規則制定中。

科技并不是天然站在道德一邊,而是站在利益這一邊的。科技巨頭更愿意和那些能幫他們實現利益的一方合作。在新書《庫克傳》的最后,闡述了蘋果近年來面對的相同問題:利用更優勢地位榨取供應商的代工廠,必然導致供應商強壓成本,產生更多社會責任問題。

在不為人知的另一面,網絡清道夫們短期內也依舊只能拿著與所受精神暴力不成正比的低廉工資,“高尚”而卑微地活著。